Тарик Саиди

Анализируя события последних двух недель, я отмечаю один аспект этого конфликта, который проявляется со спокойной, но неоспоримой ясностью: центральная роль искусственного интеллекта в том, как выбираются, приоритизируются и наносятся удары.

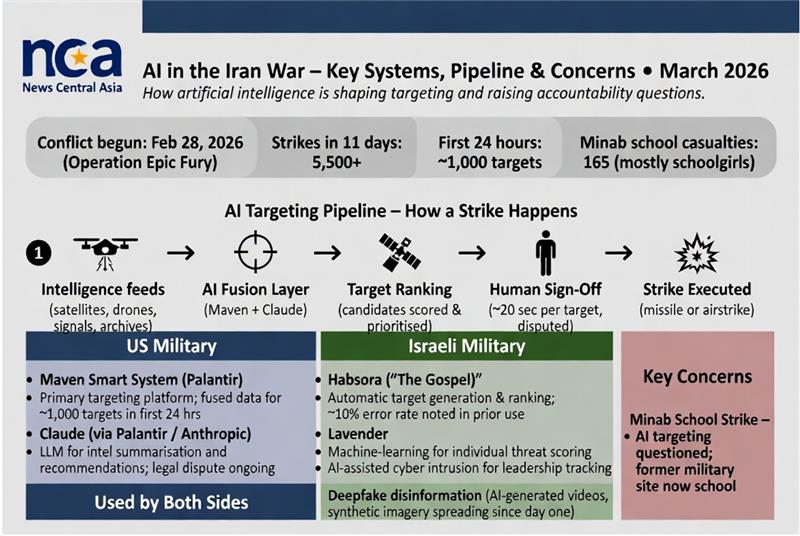

В рамках операции «Эпическая ярость» (Epic Fury), начавшейся 28 февраля 2026 года, за одиннадцать дней было нанесено более 5500 ударов — примерно 1000 из них пришлась только на первые 24 часа.

Публичные отчеты и официальные заявления подтверждают, что системы ИИ сыграли ключевую роль в обеспечении такого темпа, обрабатывая огромные потоки разведывательных данных гораздо быстрее, чем это позволили бы традиционные методы.

Процесс выстроен в виде структурированного конвейера. Разведывательные данные со спутников, беспилотников, средств радиоэлектронной разведки и архивных баз сначала поступают на уровень «ИИ-синтеза». Там системы, подобные Maven Smart System от компании Palantir, усиленные большой языковой моделью Claude от Anthropic, синтезируют и обобщают информацию. Затем цели ранжируются и приоритизируются, после чего оператор-человек дает финальное одобрение — шаг, который, по многочисленным свидетельствам, может занимать всего двадцать секунд на одну рекомендацию. Только после этого наносится удар.

Со стороны США основной платформой стала Maven Smart System. Она объединяет спутниковые снимки, видео с дронов и данные радиоперехвата для генерации и ранжирования потенциальных целей. Claude, интегрированная в Maven, помогает суммировать сложные потоки данных и формировать готовые к исполнению рекомендации.

Сообщается, что именно эта связка позволила командованию выявить и поразить около 1000 иранских целей в первый же день кампании.

Вспомогательную инфраструктуру обеспечивает Project Nimbus — облачный контракт между израильским правительством и компаниями AWS/Google Cloud. Он предоставляет вычислительные мощности и общие инструменты ИИ как для израильских, так и, в определенных случаях, для американских операций.

Израильские системы работают параллельно. «Хабсора» (Habsora), известная внутри ведомств как «Евангелие», служит основным механизмом целеуказания, автоматически генерируя и ранжируя огромные объемы потенциальных объектов для удара со скоростью, которая была недостижима в предыдущих конфликтах.

«Лаванда» (Lavender) — инструмент машинного обучения, изначально разработанный для оценки индивидуальных угроз, — также прошла оценку на предмет использования против иранских целей.

В одном из примечательных случаев израильская разведка, по имеющимся данным, получила доступ к сети камер дорожного движения в Тегеране. Использование обработки данных с помощью ИИ позволило отслеживать передвижения и способствовало нанесению удара, в результате которого был ликвидирован верховный лидер аятолла Али Хаменеи.

Эти возможности обеспечили неоспоримую оперативную скорость. Тем не менее, они также породили серьезные вопросы относительно надежности систем и человеческого контроля.

Трагический удар по начальной школе «Шаджаре Тайебе» (Shajareh Tayyebeh) в Минабе, в результате которого погибли около 165 человек — большинство из них школьницы в возрасте от 7 до 12 лет — в настоящее время находится на рассмотрении Пентагона. Ранее этот объект использовался в военных целях; отчеты предполагают, что рекомендация ИИ могла не в полной мере учитывать изменение статуса здания.

В ходе дискуссий в Конгрессе и СМИ возникли опасения по поводу «предвзятости автоматизации» (automation bias) — склонности операторов, находящихся в условиях нехватки времени, слишком поспешно принимать предложения ИИ. Также упоминается примерно 10-процентный уровень ошибок, который наблюдался при более ранних развертываниях аналогичных израильских систем в Газе.

Обе стороны также используют созданные ИИ дипфейки и синтетические изображения для формирования нужных нарративов. С первого дня конфликта в социальных сетях широко распространяются сфабрикованные видеоролики и отредактированные фотографии ударов, взрывов и сцен с гражданским населением, что затрудняет понимание ситуации общественностью и добавляет еще один слой неопределенности в информационную среду.

Что касается других крупных разработчиков ИИ, компания OpenAI заключила отдельное соглашение с Министерством обороны США на разработку секретных систем. Компания подчеркнула наличие дополнительных защитных барьеров (guardrails) в своем контракте, включая запрет на принятие определенных высокорискованных автоматизированных решений.

Однако, в отличие от Claude компании Anthropic, модели OpenAI не фигурировали в публичных отчетах как часть основной цепочки целеуказания в этой кампании. Их роль, по всей видимости, ограничивается более широкой инфраструктурой или вспомогательными функциями, что соответствует заявленной политике фирмы против прямого участия в разработке летальных автономных систем.

В результате этих событий вырисовывается конфликт, в котором Искусственный Интеллект радикально сжал «цепочку поражения» (kill chain), формально сохранив за человеком право окончательного решения. Технология не устранила необходимость в суждении — она лишь изменила темп, в котором это суждение должно выноситься.

По мере продолжения кампании баланс между скоростью, точностью и подотчетностью остается одной из определяющих — и наиболее пристально наблюдаемых — характеристик этой войны.///nCa, 16 марта 2026 г.